**端侧可用的 GPT-4o 级视觉、语音、多模态实时流式大模型**

中文 |

[English](./README.md)

微信社区 |

🍳 使用指南

**端侧可用的 GPT-4o 级视觉、语音、多模态实时流式大模型**

中文 |

[English](./README.md)

微信社区 |

🍳 使用指南

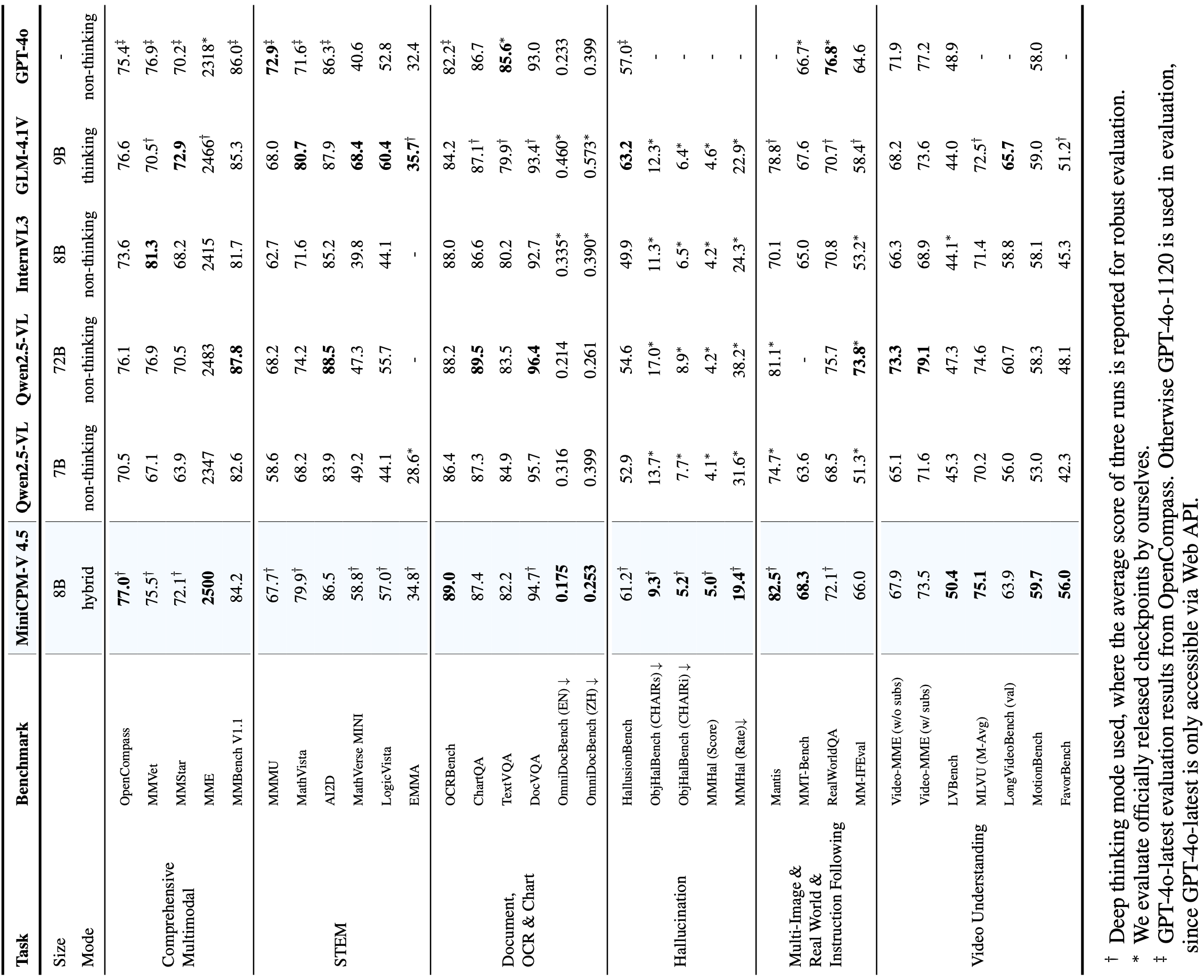

| Model | Size | Token Density+ | OpenCompass | OCRBench | MathVista mini | ChartQA | MMVet | MMStar | MME | MMB1.1 test | AI2D | MMMU val | HallusionBench | TextVQA val | DocVQA test | MathVerse mini | MathVision | MMHal Score |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Proprietary | ||||||||||||||||||

| GPT-4o-20240513 | - | 1088 | 69.9 | 736 | 61.3 | 85.7 | 69.1 | 63.9 | 2328.7 | 82.2 | 84.6 | 69.2 | 55.0 | - | 92.8 | 50.2 | 30.4 | 3.6 |

| Claude3.5-Sonnet | - | 750 | 67.9 | 788 | 61.6 | 90.8 | 66.0 | 62.2 | 1920.0 | 78.5 | 80.2 | 65.9 | 49.9 | - | 95.2 | - | - | 3.4 |

| Gemini 1.5 Pro | - | - | 64.4 | 754 | 57.7 | 81.3 | 64.0 | 59.1 | 2110.6 | 73.9 | 79.1 | 60.6 | 45.6 | 73.5 | 86.5 | - | 19.2 | - |

| GPT-4o-mini-20240718 | - | 1088 | 64.1 | 785 | 52.4 | - | 66.9 | 54.8 | 2003.4 | 76.0 | 77.8 | 60.0 | 46.1 | - | - | - | - | 3.3 |

| Open Source | ||||||||||||||||||

| Cambrian-34B | 34B | 1820 | 58.3 | 591 | 50.3 | 75.6 | 53.2 | 54.2 | 2049.9 | 77.8 | 79.5 | 50.4 | 41.6 | 76.7 | 75.5 | - | - | - |

| GLM-4V-9B | 13B | 784 | 59.1 | 776 | 51.1 | - | 58.0 | 54.8 | 2018.8 | 67.9 | 71.2 | 46.9 | 45.0 | - | - | - | - | - |

| Pixtral-12B | 12B | 256 | 61.0 | 685 | 56.9 | 81.8 | 58.5 | 54.5 | - | 72.7 | 79.0 | 51.1 | 47.0 | 75.7 | 90.7 | - | - | - |

| DeepSeek-VL2-27B (4B) | 27B | 672 | 66.4 | 809 | 63.9 | 86.0 | 60.0 | 61.9 | 2253.0 | 81.2 | 83.8 | 54.0 | 45.3 | 84.2 | 93.3 | - | - | 3.0 |

| Qwen2-VL-7B | 8B | 784 | 67.1 | 866 | 58.2 | 83.0 | 62.0 | 60.7 | 2326.0 | 81.8 | 83.0 | 54.1 | 50.6 | 84.3 | 94.5 | 31.9 | 16.3 | 3.2 |

| LLaVA-OneVision-72B | 72B | 182 | 68.1 | 741 | 67.5 | 83.7 | 60.6 | 65.8 | 2261.0 | 85.0 | 85.6 | 56.8 | 49.0 | 80.5 | 91.3 | 39.1 | - | 3.5 |

| InternVL2.5-8B | 8B | 706 | 68.3 | 822 | 64.4 | 84.8 | 62.8 | 62.8 | 2344.0 | 83.6 | 84.5 | 56.0 | 50.1 | 79.1 | 93.0 | 39.5 | 19.7 | 3.4 |

| MiniCPM-V 2.6 | 8B | 2822 | 65.2 | 852* | 60.6 | 79.4 | 60.0 | 57.5 | 2348.4* | 78.0 | 82.1 | 49.8* | 48.1* | 80.1 | 90.8 | 25.7 | 18.3 | 3.6 |

| MiniCPM-o 2.6 | 8B | 2822 | 70.2 | 897* | 71.9* | 86.9* | 67.5 | 64.0 | 2372.0* | 80.5 | 85.8 | 50.4* | 51.9 | 82.0 | 93.5 | 41.4* | 23.1* | 3.8 |

| Model | Size | BLINK val | Mantis Eval | MIRB | Video-MME (wo / w subs) |

|---|---|---|---|---|---|

| Proprietary | |||||

| GPT-4o-20240513 | - | 68 | - | - | 71.9/77.2 |

| GPT4V | - | 54.6 | 62.7 | 53.1 | 59.9/63.3 |

| Open-source | |||||

| LLaVA-NeXT-Interleave 14B | 14B | 52.6 | 66.4 | 30.2 | - |

| LLaVA-OneVision-72B | 72B | 55.4 | 77.6 | - | 66.2/69.5 |

| MANTIS 8B | 8B | 49.1 | 59.5 | 34.8 | - |

| Qwen2-VL-7B | 8B | 53.2 | 69.6* | 67.6* | 63.3/69.0 |

| InternVL2.5-8B | 8B | 54.8 | 67.7 | 52.5 | 64.2/66.9 |

| MiniCPM-V 2.6 | 8B | 53 | 69.1 | 53.8 | 60.9/63.6 |

| MiniCPM-o 2.6 | 8B | 56.7 | 71.9 | 58.6 | 63.9/67.9 |

| Task | Size | ASR (zh) | ASR (en) | AST | Emotion | |||||

|---|---|---|---|---|---|---|---|---|---|---|

| Metric | CER↓ | WER↓ | BLEU↑ | ACC↑ | ||||||

| Dataset | AISHELL-1 | Fleurs zh | WenetSpeech test-net | LibriSpeech test-clean | GigaSpeech | TED-LIUM | CoVoST en2zh | CoVoST zh2en | MELD emotion | |

| Proprietary | ||||||||||

| GPT-4o-Realtime | - | 7.3* | 5.4* | 28.9* | 2.6* | 12.9* | 4.8* | 37.1* | 15.7* | 33.2* |

| Gemini 1.5 Pro | - | 4.5* | 5.9* | 14.3* | 2.9* | 10.6* | 3.0* | 47.3* | 22.6* | 48.4* |

| Open-Source | ||||||||||

| Qwen2-Audio-7B | 8B | - | 7.5 | - | 1.6 | - | - | 45.2 | 24.4 | 55.3 |

| Qwen2-Audio-7B-Instruct | 8B | 2.6* | 6.9* | 10.3* | 3.1* | 9.7* | 5.9* | 39.5* | 22.9* | 17.4* |

| GLM-4-Voice-Base | 9B | 2.5 | - | - | 2.8 | - | - | - | - | |

| MiniCPM-o 2.6 | 8B | 1.6 | 4.4 | 6.9 | 1.7 | 8.7 | 3.0 | 48.2 | 27.2 | 52.4 |

| Task | Size | SpeechQA | ||||||||

|---|---|---|---|---|---|---|---|---|---|---|

| Metric | ACC↑ | G-Eval (10 point)↑ | Semantic ELO score↑ | Acoustic ELO score↑ | Overall ELO score↑ | UTMOS↑ | ASR-WER↓ | |||

| Dataset | Speech Llama Q. | Speech Web Q. | Speech Trivia QA | Speech AlpacaEval | AudioArena | |||||

| Proprietary | ||||||||||

| GPT-4o-Realtime | 71.7 | 51.6 | 69.7 | 7.4 | 1157 | 1203 | 1200 | 4.2 | 2.3 | |

| Open-Source | ||||||||||

| GLM-4-Voice | 9B | 50.0 | 32.0 | 36.4 | 5.1 | 999 | 1147 | 1035 | 4.1 | 11.7 |

| Llama-Omni | 8B | 45.3 | 22.9 | 10.7 | 3.9 | 960 | 878 | 897 | 3.2 | 24.3 |

| VITA-1.5 | 8B | 46.7 | 28.1 | 23.3 | 2.0 | - | - | - | - | - |

| Moshi | 7B | 43.7 | 23.8 | 16.7 | 2.4 | 871 | 808 | 875 | 2.8 | 8.2 |

| Mini-Omni | 1B | 22.0 | 12.8 | 6.9 | 2.5 | 926 | 803 | 865 | 3.4 | 10.0 |

| MiniCPM-o 2.6 | 8B | 61.0 | 40.0 | 40.2 | 5.1 | 1088 | 1163 | 1131 | 4.2 | 9.8 |

| Task | TTS | |

|---|---|---|

| Metric | SIMO↑ | SIMO↑ |

| Dataset | Seed-TTS test-zh | Seed-TTS test-en |

| F5-TTS | 76 | 67 |

| CosyVoice | 75 | 64 |

| FireRedTTS | 63 | 46 |

| MiniCPM-o 2.6 | 57 | 47 |

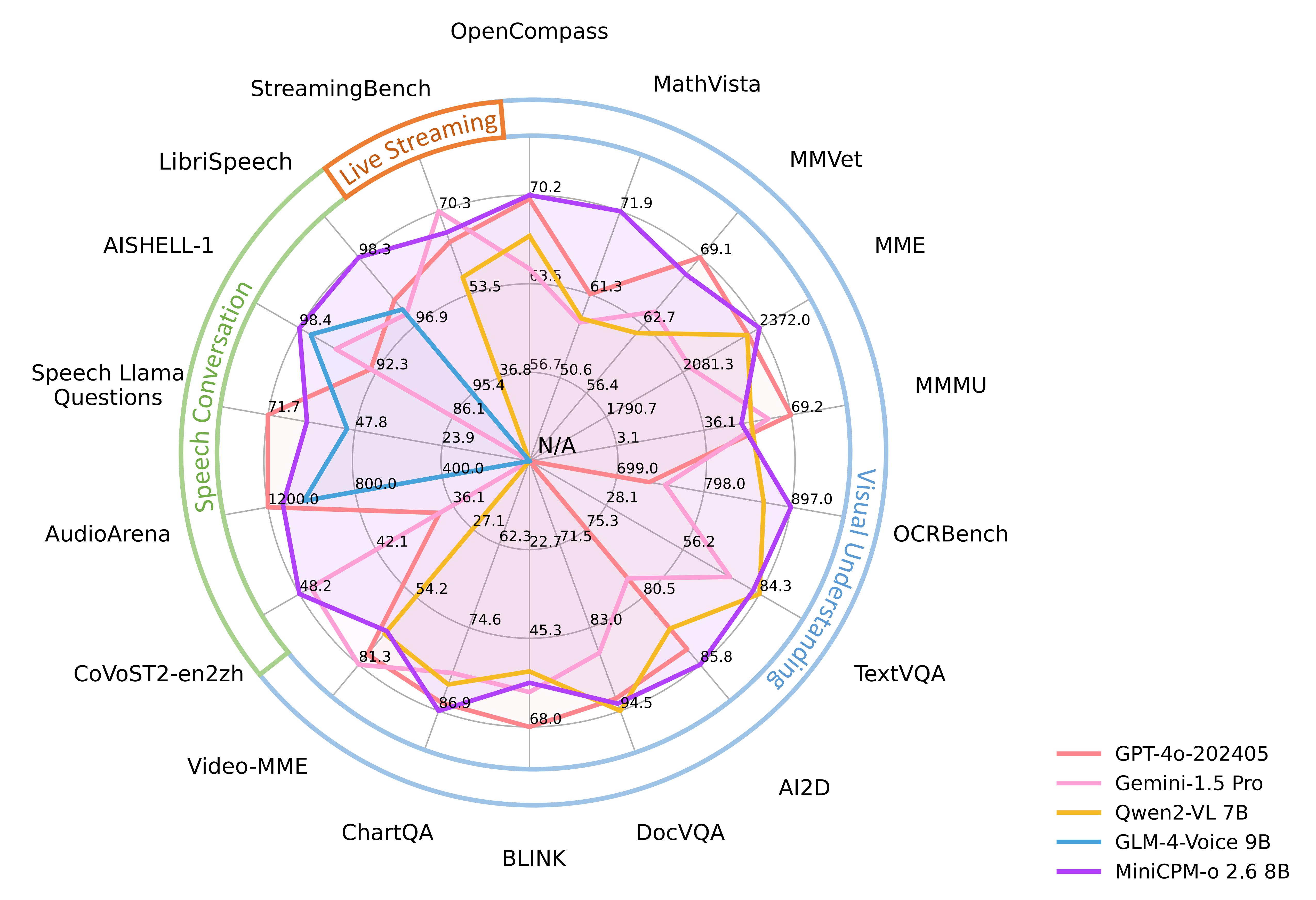

| Model | Size | Real-Time Video Understanding | Omni-Source Understanding | Contextual Understanding | Overall | |||

|---|---|---|---|---|---|---|---|---|

| Proprietary | ||||||||

| Gemini 1.5 Pro | - | 77.4 | 67.8 | 51.1 | 70.3 | |||

| GPT-4o-202408 | - | 74.5 | 51.0 | 48.0 | 64.1 | |||

| Claude-3.5-Sonnet | - | 74.0 | 41.4 | 37.8 | 59.7 | |||

| Open-source | ||||||||

| VILA-1.5 | 8B | 61.5 | 37.5 | 26.7 | 49.5 | |||

| LongVA | 7B | 63.1 | 35.9 | 30.2 | 50.7 | |||

| LLaVA-Next-Video-34B | 34B | 69.8 | 41.7 | 34.3 | 56.7 | |||

| Qwen2-VL-7B | 8B | 71.2 | 40.7 | 33.1 | 57.0 | |||

| InternVL2-8B | 8B | 70.1 | 42.7 | 34.1 | 57.0 | |||

| VITA-1.5 | 8B | 70.9 | 40.8 | 35.8 | 57.4 | |||

| LLaVA-OneVision-7B | 8B | 74.3 | 40.8 | 31.0 | 58.4 | |||

| InternLM-XC2.5-OL-7B | 8B | 75.4 | 46.2 | 33.6 | 60.8 | |||

| MiniCPM-V 2.6 | 8B | 72.4 | 40.2 | 33.4 | 57.7 | |||

| MiniCPM-o 2.6 | 8B | 79.9 | 53.4 | 38.5 | 66.0 | |||

支持的在线和本地 Demo。Gradio 是目前最流行的模型部署框架,支持流式输出、进度条、process bars 和其他常用功能。

### Online Demo

欢迎试用 Online Demo: [MiniCPM-V 2.6](http://120.92.209.146:8887/) | [MiniCPM-Llama3-V 2.5](https://huggingface.co/spaces/openbmb/MiniCPM-Llama3-V-2_5) | [MiniCPM-V 2.0](https://huggingface.co/spaces/openbmb/MiniCPM-V-2) 。

### 本地 WebUI Demo

您可以使用以下命令轻松构建自己的本地 WebUI Demo。更详细的部署教程请参考[文档](https://modelbest.feishu.cn/wiki/RnjjwnUT7idMSdklQcacd2ktnyN)。

**实时流式视频/语音通话demo:**

1. 启动model server:

```shell

pip install -r requirements_o2.6.txt

python web_demos/minicpm-o_2.6/model_server.py

```

请确保 `transformers==4.44.2`,其他版本目前可能会有兼容性问题,我们正在解决。

如果你使用的低版本的 Pytorch,你可能会遇到这个错误`"weight_norm_fwd_first_dim_kernel" not implemented for 'BFloat16'`, 请在模型初始化的时候添加 `self.minicpmo_model.tts.float()`

2. 启动web server:

```shell

# Make sure Node and PNPM is installed.

sudo apt-get update

sudo apt-get install nodejs npm

npm install -g pnpm

cd web_demos/minicpm-o_2.6/web_server

# 为https创建自签名证书, 要申请浏览器摄像头和麦克风权限须启动https.

bash ./make_ssl_cert.sh # output key.pem and cert.pem

pnpm install # install requirements

pnpm run dev # start server

```

浏览器打开`https://localhost:8088/`,开始体验实时流式视频/语音通话.

**Chatbot图文对话demo:**

```shell

pip install -r requirements_o2.6.txt

python web_demos/minicpm-o_2.6/chatbot_web_demo_o2.6.py

```

浏览器打开`http://localhost:8000/`,开始体验图文对话Chatbot.

## 推理

### 模型库

| 模型 | 设备 | 资源 | 简介 | 下载链接 |

|:--------------|:-:|:----------:|:-------------------|:---------------:|

| MiniCPM-V 4.5| GPU | 18 GB | 提供出色的端侧单图、多图、视频理解能力。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-4_5) [

支持的在线和本地 Demo。Gradio 是目前最流行的模型部署框架,支持流式输出、进度条、process bars 和其他常用功能。

### Online Demo

欢迎试用 Online Demo: [MiniCPM-V 2.6](http://120.92.209.146:8887/) | [MiniCPM-Llama3-V 2.5](https://huggingface.co/spaces/openbmb/MiniCPM-Llama3-V-2_5) | [MiniCPM-V 2.0](https://huggingface.co/spaces/openbmb/MiniCPM-V-2) 。

### 本地 WebUI Demo

您可以使用以下命令轻松构建自己的本地 WebUI Demo。更详细的部署教程请参考[文档](https://modelbest.feishu.cn/wiki/RnjjwnUT7idMSdklQcacd2ktnyN)。

**实时流式视频/语音通话demo:**

1. 启动model server:

```shell

pip install -r requirements_o2.6.txt

python web_demos/minicpm-o_2.6/model_server.py

```

请确保 `transformers==4.44.2`,其他版本目前可能会有兼容性问题,我们正在解决。

如果你使用的低版本的 Pytorch,你可能会遇到这个错误`"weight_norm_fwd_first_dim_kernel" not implemented for 'BFloat16'`, 请在模型初始化的时候添加 `self.minicpmo_model.tts.float()`

2. 启动web server:

```shell

# Make sure Node and PNPM is installed.

sudo apt-get update

sudo apt-get install nodejs npm

npm install -g pnpm

cd web_demos/minicpm-o_2.6/web_server

# 为https创建自签名证书, 要申请浏览器摄像头和麦克风权限须启动https.

bash ./make_ssl_cert.sh # output key.pem and cert.pem

pnpm install # install requirements

pnpm run dev # start server

```

浏览器打开`https://localhost:8088/`,开始体验实时流式视频/语音通话.

**Chatbot图文对话demo:**

```shell

pip install -r requirements_o2.6.txt

python web_demos/minicpm-o_2.6/chatbot_web_demo_o2.6.py

```

浏览器打开`http://localhost:8000/`,开始体验图文对话Chatbot.

## 推理

### 模型库

| 模型 | 设备 | 资源 | 简介 | 下载链接 |

|:--------------|:-:|:----------:|:-------------------|:---------------:|

| MiniCPM-V 4.5| GPU | 18 GB | 提供出色的端侧单图、多图、视频理解能力。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-4_5) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-V-4_5) |

| MiniCPM-V 4.5 gguf | CPU | 8 GB | gguf 版本,更低的内存占用和更高的推理效率。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-4_5-gguf) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-V-4_5) |

| MiniCPM-V 4.5 gguf | CPU | 8 GB | gguf 版本,更低的内存占用和更高的推理效率。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-4_5-gguf) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-V-4_5-gguf) |

| MiniCPM-V 4.5 int4 | GPU | 9 GB | int4量化版,更低显存占用 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-4_5-int4) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-V-4_5-gguf) |

| MiniCPM-V 4.5 int4 | GPU | 9 GB | int4量化版,更低显存占用 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-4_5-int4) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-V-4_5-int4) |

| MiniCPM-o 2.6| GPU | 18 GB | 最新版本,提供端侧 GPT-4o 级的视觉、语音、多模态流式交互能力。 | [🤗](https://huggingface.co/openbmb/MiniCPM-o-2_6) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-V-4_5-int4) |

| MiniCPM-o 2.6| GPU | 18 GB | 最新版本,提供端侧 GPT-4o 级的视觉、语音、多模态流式交互能力。 | [🤗](https://huggingface.co/openbmb/MiniCPM-o-2_6) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-o-2_6) |

| MiniCPM-o 2.6 gguf | CPU | 8 GB | gguf 版本,更低的内存占用和更高的推理效率。 | [🤗](https://huggingface.co/openbmb/MiniCPM-o-2_6-gguf) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-o-2_6) |

| MiniCPM-o 2.6 gguf | CPU | 8 GB | gguf 版本,更低的内存占用和更高的推理效率。 | [🤗](https://huggingface.co/openbmb/MiniCPM-o-2_6-gguf) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-o-2_6-gguf) |

| MiniCPM-o 2.6 int4 | GPU | 9 GB | int4量化版,更低显存占用。 | [🤗](https://huggingface.co/openbmb/MiniCPM-o-2_6-int4) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-o-2_6-gguf) |

| MiniCPM-o 2.6 int4 | GPU | 9 GB | int4量化版,更低显存占用。 | [🤗](https://huggingface.co/openbmb/MiniCPM-o-2_6-int4) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-o-2_6-int4) |

| MiniCPM-V 2.6| GPU | 17 GB | 提供出色的端侧单图、多图、视频理解能力。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-2_6) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-o-2_6-int4) |

| MiniCPM-V 2.6| GPU | 17 GB | 提供出色的端侧单图、多图、视频理解能力。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-2_6) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-V-2_6) |

| MiniCPM-V 2.6 gguf | CPU | 6 GB | gguf 版本,更低的内存占用和更高的推理效率。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-2_6-gguf) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-V-2_6) |

| MiniCPM-V 2.6 gguf | CPU | 6 GB | gguf 版本,更低的内存占用和更高的推理效率。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-2_6-gguf) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-V-2_6-gguf) |

| MiniCPM-V 2.6 int4 | GPU | 7 GB | int4量化版,更低显存占用。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-2_6-int4) [

](https://modelscope.cn/models/OpenBMB/MiniCPM-V-2_6-gguf) |

| MiniCPM-V 2.6 int4 | GPU | 7 GB | int4量化版,更低显存占用。 | [🤗](https://huggingface.co/openbmb/MiniCPM-V-2_6-int4) [ ](https://modelscope.cn/models/OpenBMB/MiniCPM-V-2_6-int4) |

更多[历史版本模型](#legacy-models)

### 多轮对话

如果您希望开启长思考模式,请向 `chat` 函数传入参数 `enable_thinking=True`

```shell

pip install -r requirements_o2.6.txt

```

](https://modelscope.cn/models/OpenBMB/MiniCPM-V-2_6-int4) |

更多[历史版本模型](#legacy-models)

### 多轮对话

如果您希望开启长思考模式,请向 `chat` 函数传入参数 `enable_thinking=True`

```shell

pip install -r requirements_o2.6.txt

```

[清华大学自然语言处理实验室](https://nlp.csai.tsinghua.edu.cn/)

-

[清华大学自然语言处理实验室](https://nlp.csai.tsinghua.edu.cn/)

-  [面壁智能](https://modelbest.cn/)

## 🌟 Star History

[面壁智能](https://modelbest.cn/)

## 🌟 Star History